| 日時: | 2026-04-18 |

|---|---|

| 作: | 時雨堂 |

| バージョン: | 2026.1 |

| url: | https://sora.shiguredo.jp/ |

Contents

- 概要

- 時雨堂ノハナシ

- Sora Labo

- Sora Cloud

- セミナー

- SFU

- ブラウザ対応

- OBS 対応

- 目的

- WebRTC SFU Sora の特徴

- ドキュメント

- サポート

- 超低遅延

- 超高画質

- 超大規模配信

- 100 万以上の視聴者への配信

- IPv6 のみ

- 4K 配信

- 無変換

- パッケージ

- クラスター

- スケールアウト

- ロードバランサー

- サーバ主導

- サーバでの録画

- 録画ファイルの分割出力

- マルチストリーム

- スポットライト機能

- OBS WHIP 対応機能

- TURN 機能

- サイマルキャスト機能

- シグナリング

- DataChannel シグナリング機能

- DataChannel メッセージング機能

- シグナリング通知機能

- モード機能

- 認証ウェブフック

- セッションウェブフック

- イベントウェブフック

- API

- 転送フィルター機能

- 統計エクスポーター機能

- 音声ストリーミング機能

- 開発ツール機能

- End to End Encryption

- 前方誤り訂正対応 (ULPFEC)

- AV1 対応

- H.265 対応

- SDK

- 負荷試験ツール

- 録画合成ツール

- 統計情報収集ツール

- 音声ストリーミングゲートウェイ

- Sora Exporter

- Sora Archive Uploader

- サンプル

- ゴール

- 動作環境

- 現状

- ライセンス

- Sora Cloud

- WebRTC 系の自社製品

- 参考

時雨堂 が 1 から開発し、販売している WebRTC SFU の開発ログです。

興味がある方は sora at shiguredo.jp までご連絡ください (このメールアドレスへの特定電子メールの送信を拒否いたします)

Medium にて WebRTC SFU Sora についての技術的な記事を公開しています。是非覗いてみてください。

https://medium.com/shiguredo/tagged/sora

WebRTC SFU Sora を検証目的であれば無料で試せる Sora Labo というサービスを公開しています。 GitHub のアカウントだけあればすぐに利用可能なので是非試してみて下さい。

WebRTC SFU Sora のクラウド版です。同時接続数と利用帯域での課金で、転送量や利用時間では課金されません。

不定期ではありますが、時雨堂製品についての最新情報を話す雑談イベントを開催しています。

時雨堂 WebRTC 不定期オンライン雑談配信 (SHIGURADIO)

SFU は Selective Forwarding Unit の略で、簡単に言えば SFU と呼ばれるサーバが音声や映像、 またはそれ以外のデータを配信者に変わって複数の視聴者に配信してくれる仕組みです。

また SFU は音声や映像を再変換せず配信するため、 サーバを経由したとしても遅延を 1 秒未満に抑えることが可能になります。

SFU を利用すれば 1:N の配信を気軽に行う事ができます。もちろん 2:N や 3:N と配信者を複数にすることも可能です。

/ -> WebRTC -> 視聴者

/ -> WebRTC -> 視聴者

配信者 -> WebRTC -> SFU -> WebRTC -> 視聴者

\ -> WebRTC -> 視聴者

\ -> WebRTC -> 視聴者

後述するクラスターリレー機能を利用することで最大百万同時接続を超えるクライアントに配信することができます。

SFU の配信機能を応用することで複数人の配信を一つの PeerConnection で利用することができます。

この機能は「マルチストリーム」と呼ばれています。 つまり自分の映像を複数人に配信せず、そこは SFU に任せ、他の人の映像のみを受け取るとい仕組みです。

参加者 A <- (WebRTC) -> <- (WebRTC) -> 参加者 D 参加者 B <- (WebRTC) -> SFU <- (WebRTC) -> 参加者 E 参加者 C <- (WebRTC) -> <- (WebRTC) -> 参加者 F

全員がそろってから開始するため、その人の映像や音声は後から設定されます。 マルチストリームを利用することで、一つの PeerConnection 上に動的に映像や音声を追加削除する仕組みがマルチストリームです。

クライアントは ontrack のコールバックを利用し、複数人数での映像音声の仕組みを利用することができます。

参加者の詳細:

-> 自分 A の映像 (WebRTC) ->

参加者 A <- 他の参加者 B の映像 (WebRTC) <- SFU

<- 他の参加者 C の映像 (WebRTC) <-

さらに Sora を利用すればこの複数人数の映像を全てサーバサイドで録画することができます。

サイマルキャストは配信者が複数の画質の映像を送ることで、視聴者が画質を選択できるようになります。 この機能はクライアント側と SFU 側両方がサイマルキャストでの配信に対応している必要があります。

/ -> WebRTC(高画質) -> 視聴者

-> WebRTC(高画質) -> / -> WebRTC(中画質) -> 視聴者

配信者 -> WebRTC(中画質) -> SFU -> WebRTC(中画質) -> 視聴者

-> WebRTC(低画質) -> \ -> WebRTC(中画質) -> 視聴者

\ -> WebRTC(低画質) -> 視聴者

双方向配信とサイマルキャストを組み合わせることで、 複数人の配信でも「自信が受信したい画質」を選択して受信することができるようになります。 マシンスペックが低かったり、回線が不安定な場合は低画質の配信、低画質の受信を選択できます。

WebRTC SFU の課題である「全員が同じ画質を受信する必要がある」というものを解決する、画期的な仕組みです。

-> WebRTC(高画質) ->

参加者 A -> WebRTC(中画質) -> <- WebRTC(中画質) <-

-> WebRTC(低画質) -> SFU <- WebRTC(低画質) <- 参加者 B

<- WebRTC(高画質) <- -> WebRTC(低画質) ->

時雨堂独自の機能です

双方向配信とサイマルキャストを組み合わせるて、さらに発話しているかどうかの判断を利用することで、 直近で話をした N 人は高画質で音声あり、それ以外は低画質で音声なしという仕組みを提供しています。 これによりクライアントとサーバ両方の CPU 負荷、ネットワーク負荷を削減することができるようになります。

受信する映像の画質はクライアント単位で指定でき、話をしたとしても映像を受信しないなども実現可能です。

時雨堂独自の機能です

クラスターリレーは Raft ベースの分散システムを WebRTC SFU に組み込む事で、どのサーバーからでも同一のチャネル(ルーム)に参加することができるようになる仕組みです。

この仕組みを利用することで、スケールアウトが可能になり、超低遅延で百万以上の視聴者への配信を実現できます。

最新の Chrome / Firefox / Safari / Edge とすべての主要ブラウザに対応済みです。

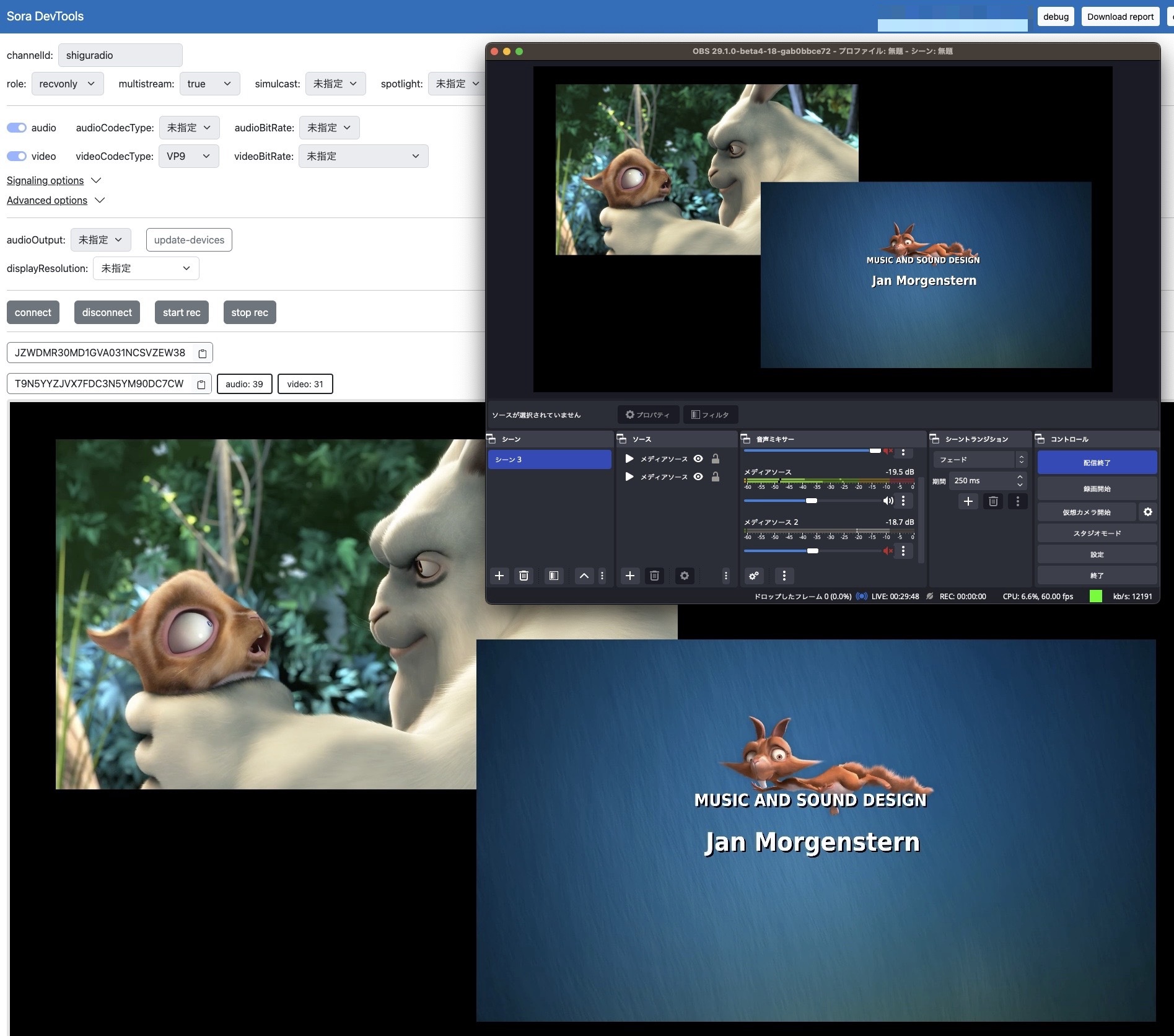

OBS Studio 30 から WebRTC 経由で音声や映像を直接 WebRTC SFU に送れるようになります。

WebRTC は映像と音声をリアルタイムに配信する仕組みです。ただ P2P の場合は大量の配信を行うことは難しくなります。 そこでサーバを経由することで遅延が少ない状態で配信を 1000 人といった規模に対して配信が可能になります。

通常の WebRTC はブラウザとブラウザの間で実現する仕組みですが、 サーバサイド WebRTC ではブラウザとサーバの間で WebRTC を実現します。

サーバサイドでの録画を行う場合はサーバサイドでの WebRTC スタックが無ければできません。 録画以外にもスター型で WebRTC を繋ぐ場合にも必要です。

サーバでの WebRTC 可能性を探るために 1 から WebRTC スタックを開発しています。

細かいところまで網羅した、ドキュメントを提供しています。

Sora 開発チームが直接サポート対応を行います。

WebRTC SFU Sora は低遅延を目的に作られた製品です。遅延は環境にも寄りますが基本的には 1 秒未満です。

WebRTC SFU Sora を利用すればカメラや CPU や回線、さらにはクライアント側の対応が必要になりますが 4K@30 での超高画質を最大 15Mbps で安定的に配信可能です。

再送制御を WebRTC SFU 側で高ビットレート向けに制御することにより実現を可能にしています。

左が元の映像、右が WebRTC SFU Sora を経由した映像

- コーデックは AV1

- 1080p 30fps 3000 kbps

- 東京 -> 大阪(サーバー) -> 東京

- インターネット経由

- 送受信ともブラウザで Chrome を利用

https://gyazo.com/cb70222d4ab92f0a55bdf7fa67b50d22

WebRTC SFU Sora を利用すれば、クラスター機能を利用することで数百万ユーザーに配信することもできます。

ビットレートに依存しますが、クラスターリレー機能を利用することで、片方向配信で多くのクライアントへの配信が可能です。

IPv6 のみの環境での動作をします。

4K 30fps 15Mbps の映像を、片方向配信での配信も可能です。

WebRTC SFU は映像のコーデックなど変換を一切行わないで、複数の視聴者に映像や音声を配信する仕組みです。 変換を行わないため、サーバのリソースを節約することが可能です。

さらに Sora は録画も無変換で行います。

サービスではなくパッケージ製品です。サービスの場合は従量課金がほとんどです。Sora は年間の利用ライセンスだけです。 またクローズドなネットワークでも利用可能です。サービスに左右されることなく自前で気軽に運用可能です。

数ヶ月に一度の定期的なアップデート以外はやることはなく放置していて問題ありません。

Sora は複数台でクラスターを組むことができます。 クラスターが組んでる Sora ノードのどれかが障害が起きた場合、再接続するだけで復旧可能です。

Sora クラスターでは指定した Channel ID がどの Sora ノードに接続するべきかを共有しています。 そのため、どれかの Sora ノードに障害が起きたとしても、適切なノードに再接続できる仕組みを搭載しています。

また、ネットワーク障害が起きても自動で復旧する仕組みが組み込まれています。

クラスターの Sora ノードを追加するだけでスケールアウトが可能です。 スケールインも気軽にできます。

Sora はクラスターを構築することでロードバランサー機能を提供します。そのためロードバランサーを別に用意する必要はありません。 Channel ID の割り当てノードを選択する際に、接続割合が低いノードを選択します。

サーバ側がクライアントをコントロールし、サーバ側が色々吸収するため、クライアント側の開発コストが下がります。

またサーバ側でクライアントの切断などをコントロールしやすいため、ビジネス用途に向いています。

WebRTC SFU は映像の暗号化をいったんほどいてから配信しているため、 サーバ側で映像を保存することが可能になります。

つまり好きなタイミングで配信している映像を保存可能です。

さらに変換せずその流れている映像そのままの画質で保存が可能です。 VP8 + Opus または VP9 + Opus さらに H.264 + Opus の三種類形式で動画を保存可能です。

無変換で録画するため、サーバのリソースを配信に集中することができます。 またすぐに録画したファイルを見ることができます。

録画時にリップシンクを行っているため、ある程度のパケロスでも音ズレを回避できるようになっています。

サイマルキャストやスポットライトを利用した場合でも録画が可能です。

Sora には一定期間ごとに録画ファイルを出力する機能あり、24/365 の配信を録画することも可能です。

Firefox と Chrome と Safari と Edge に対応済みです

WebRTC では複数の映像を 1 本のセッションで束ねる マルチストリームという仕組みがあります。

SFU を使った場合は配信は 1 つですが、視聴は複数になる事があるため、 マルチストリーム と SFU の相性はよく、今後は マルチストリーム が主流になっています。

SFU で マルチストリーム を使うと DTLS セッションを 1 本だけ張れば良くなります。 WebRTC API の ontrack/onremovetrack イベントを活用することで、参加者の通知を気軽に行えます。

動的にクライアント側の実装がとてもシンプルになります。

実際に Firefox と WebRTC SFU を使った マルチストリーム のデモを動画にしてみました。

Firefox 45 と WebRTC SFU Sora を使った マルチストリーム のデモ - YouTube

詳細は Sora のドキュメント マルチストリーム をご覧ください

映像を有効にした際のマルチストリームでの一つのチャネルへの最大参加人数は 12 名程度です。 制限はかかっていないため最大人数は増やすことはできますが、 これ以上はクライアント側が耐えられない可能性が高いです。

これ以上を利用する場合はスポットライト機能を検討してください。 スポットライト機能を利用すれば一つのチャネルへの最大参加人数が 50 名までに増やすことが可能になります。

マルチストリームの課題は参加者全員が同じ画質の映像を受信するというものですが、サイマルキャストを利用することでこの課題を解決できます。

たとえば A さんは自宅のデスクトップマシンから利用しており「高画質」の映像を受信しても問題ありませんが、 出先からスマートフォンで利用している B さんは「高画質」の映像を受信すると映像が止まってしまったりする可能性があります。

サイマルキャストを利用することで B さんは A さんが配信している「高画質」「中画質」「低画質」の3つから「低画質」を受信するという選択ができるようになります。

マルチストリーム利用時にサイマルキャストを利用した場合、しない場合を混合して利用可能です。 サイマルキャストで配信されている映像は画質の切り替えが可能になります。

利用者は特に何かを意識する必要はありません。

マルチストリームのビットレート指定は現在マルチストリームに配信で参加している人数でわった値で配信するという機能です。

たとえばボットレートの指定を 1000kbps にして、そのマルチストリームに 4 名参加している場合、 配信する映像のビットレートは 250kbps となります。もし 1 名参加者が減って 3 名になった場合は 333kbps となります。

マルチストリームでは全員で共有する最大で利用可能な配信ビットレートの値を指定することになります。

マルチストリームでの録画を実現しました。指定したグループに対しての録画を事前に指定できます。

録画を指定してからその録画有効期限が切れるまでは、そのグループでの映像や音声は自動で録画されるようになります。

この機能を利用することで、気軽に複数人数の録画が可能になります。

さらに録画したファイルの生成が完了したタイミングや、録画が開始されたタイミングでウェブフックから通知がくるため、アプリとの連携が簡単になります。

マルチストリームで配信している映像を、映像を配信せず視聴のみで参加することができます。

この機能を使うことで同じチャネルに 4 人が参加して配信をしているのを、他の人がみるという事が可能になります。

4 人の配信を 30 人が視聴するなどが可能になります

Chrome と Edge と Safari に対応しています

この機能を使うことでサーバが配信する内容を「直近で喋っていた人たち」とそれ以外で切り替えられます。

- 直近で喋っていた人たちは「高画質」で「音声あり」

- それ以外の人たちは「低画質」で「音声なし」

こうすることで受信側の負荷を下げながらも多くの情報量を提供可能になります。

- アンフォーカス時に受信する RID を指定可能です

- フォーカス時に受信する RID を指定可能です

- アンフォーカス時にフォーカスを遅延させるかどうかを指定可能です

- アンフォーカス時にフォーカスを遅延させる時間を指定可能です

- アンフォーカス時に音声を配信しなくなる上限値を指定可能です

- フォーカスからアンフォーカスに切り替わったタイミングで音声を配信し続けるかどうかを指定可能です

- フォーカスからアンフォーカスに切り替わったタイミングで音声を配信し続ける時間を指定可能です

OBS Studio 30 から対応する OBS が直接 WebRTC を配信することができるようになる WHIP を実装しています。

これにより OBS から WebRTC SFU Sora に直接配信することが可能になります。

Sora は TURN 機能を内蔵しているため、 TURN サーバを別に立てる必要がなくなります。 現時点では TURN-UDP と TURN-TCP に対応しています。今後は TURN-TLS への対応も予定しています。

TURN 機能を内蔵することで TURN 利用時に必須な認証などを全て自動で行ってくれます。 また WebRTC 通信自体に認証がかからないため TURN を前提とすることで、よりセキュアに WebRTC を利用することが可能になります。

詳細は Sora のドキュメント TURN 機能 をご覧ください

Sora では TURN-TLS 自体を処理する機能は搭載しません。 TURN-TLS は TURN-TCP の TLS 版です。 この機能は TURN-TLS の urls turns: を払い出すようにする機能です。

実際の TLS の処理は Nginx などを利用して前段で終端して、そのご TURN-TCP に繋ぐという仕組みです。

TCP serverをSSL/TLS化するのに nginx の stream_ssl_module/stream_proxy_module が便利 - たごもりすメモ

Sora では Nginx などを前段において貰うことを前提としています。そのため、 TLS 部分の処理も前段に任せてしまうという方針です。

サイマルキャストとはクライアント側は複数の画質の映像を同時に送ってくるという仕組みです。

現時点で Sora では最新版の Chrome と Edge と Safari で VP8 と H.264 を指定した場合のサイマルキャスト機能に対応しています。

サイマルキャストを使うことで WebRTC の課題の一つである視聴者側が複数いる場合に配信ビットレートが一つになってしまうという問題を解決できます。

つまり配信者は高画質で配信しているが、ある視聴者は端末や回線の問題から低画質で見たい。という問題です。

これを解決するのがサイマルキャストで配信者が複数の画質の映像を SFU に配信し、 SFU から視聴者へは望む画質を配信するという仕組みです。

Sora ではさらに配信者側が不安定になり優先度が低いが質が配信できなくなった場合、 視聴者がその画質の映像を見ていたとしてもクライアントが特に何をすることもなく、 Sora 側で配信されている画質に切り替える仕組みを導入しています。配信者が不安定ではなくなり、安定したタイミングで視聴者側の画質も戻します。

さらに視聴者側の画質を自由に切り替える API も提供しています。

シグナリングとはクライアントと SFU が WebRTC の通信を始めるために事前にやりとりをするための仕組みです。

どんな映像コーデックを使うのか、音声は配信するのかどうか、などを指定します。認証などもここで行います。

WebRTC でのシグナリングは仕様的には定義されていません。 Sora のシグナリングは WebSocket を利用しています。

WebSocket を使い、内部で JSON 形式での通信を行います。

詳細は Sora のドキュメント シグナリング をご覧ください

Sora では接続時のみ WebSocket を利用し、その後のシグナリングをすべて DataChannel を利用する仕組みを持っています。

この機能を利用することで WebSocket でおきていたヘッドオブラインブロッキングを避けることができ、より繋がり続ける事が可能になります。

Sora では DataChannel を利用したリアルタイムなメッセージング機能に対応しています。 音声や映像、さらにデータを自由に参加者に配信することができるようになります。

再送をアプリに依存させたりなど、色々な方針で配信が可能です。

接続してきたクライアントや、切断してきたクライアントの情報をシグナリングを利用している WebSocket 経由でプッシュで通知する仕組みです。

接続時にメタデータを Sora に渡しておくことで、プッシュ通知時にそのメタデータを送信します。

この機能を使うことでどの配信が誰の配信かなどを簡単に実現できるようになります。

API 経由で Sora のモードを新規接続停止や新規セッション停止のモードに切り替える事が可能です。

新規接続停止は既存の接続は継続しつつ、新規接続を停止します。

新規セッション停止は既存のセッションは継続しつつ、新規セッションを停止します。 そのため、新規でチャネルを作る事ができなくなります。

Sora 自体は認証機能を持っていません。ただし、認証の処理を外部の認証サーバに委譲することができます。

外部への認証は Sora が HTTP 経由で設定に指定されたサーバに問い合わせます。そのため Sora がデータベース連携を行う必要がありません。

詳細は Sora のドキュメント 認証ウェブフック をご覧ください。

Sora では認証サーバが払い出した JSON を利用することができます

- event_metadata の指定

- この機能はイベントフックで、接続、切断、更新時に送ってくる値をサーバ側から好きな値を指定することができます

- 例えばプライマリキーなどを保存しておくことで、アプリ側の処理を単純かすることが可能です

- この値は接続毎に保持し、クライアントに通知されることはありません

- オーディオ、ビデオの設定の指定

- サーバ側から利用するオーディオやビデオのコーデックやビットレートを指定することができます

- チャネルで利用するコーデックを統一したい場合に利用可能です

- ipv4_address や ipv6_address の指定

- サーバ側から、クライアントが利用する IP アドレスのリストを送ることができます

- これによりプライベートネットワークだけで通信して欲しい場合など、クライアントの接続をネットワークレベルでコントロールすることができるようになります

Sora ではチャネルの時間帯でのグルーピングにセッションという概念があり、セッションの開始と終了でウェブフックを飛ばすことができます。

これはチャネルを使い回して利用する事が多いため、もう一つ時間帯でのグルーピングが必要と考えたため、このウェブフックを実装しました。

Sora は状態の変化などを全てウェブフック経由でアプリケーションに通知します。

この Web フック機能を使うことで、アプリ側は通常の HTTP API アプリを書く事で Sora と連携することが可能になります。

詳細は Sora のドキュメント イベントウェブフック をご覧ください。

API は Sora が持っている HTTP API です。この API を操作することで指定したユーザを切断したり、指定したグループ全員にプッシュで情報を送るなどが利用可能になります。

詳細は Sora のドキュメント をご覧ください。

Sora の音声や映像の転送をフィルターする機能を提供しています。最初は映像を映さず音声のみを転送する。 特定の接続にだけ映像を転送するなど、転送フィルターのルールを設定することで複雑な転送ルールが実現できます。

詳細は 転送フィルター機能 をご確認ください。

WebRTC Stats をクライアント経由で Sora からさらに統計コレクターに HTTP/2 を利用して送る機能です。 接続単位の統計情報、最小 30 秒間隔で送る事ができます。

WebRTC Stats Collector Kohaku を使うことで Grafana + TimescaleDB で、ため込んだデータを可視化することが可能です。

インポートするだけですぐ利用可能な Grafana のダッシュボードも用意してあります。

クライアントから送られてくる音声パケットを、HTTP/2 経由で出力する機能です。

shiguredo/suzu: Audio Streaming Gateway Suzu を利用する事で AWS や GCP といった音声から文字起こしするサービス経由でリアルタイムな文字起こしをクライアントに配信可能になります。

サービスに音声を送る:

クライアント -> <WebRTC> -> Sora -> <HTTP/2> -> Suzu -> AWS や GCP

サービスから解析結果を受け取る:

クライアント <- <WebRTC DataChannel> <- Sora <- <HTTP/2> <- Suzu <- AWS や GCP

Sora にはオープンソースとして公開している開発ツールが組み込まれています。

Sora はブラウザ上で End to End Encryption 機能を利用可能です。

詳細は Sora E2EE ドキュメント をご覧ください。

回線が不安定になった場合でも再送することなく欠損したパケットを回復する仕組みです。 これを利用することで高ビットレートや不安定な回線での映像を配信することが可能になります。

AV1 に対応しています。

Safari TP 105 から利用可能になった WebRTC での H.265 に対応しています。

SDK の有償サポートは行っておりません、ただしバグフィックスなどは最優先で対応します

Sora には現在 JavaScript と iOS と Android と Unity の SDK が存在しています。

全ての SDK がマルチストリームに対応済です。クライアントから簡単にマルチストリームを利用することができます。

さらに常に最新の WebRTC ライブラリに追従しています。

SDK は OSS で、ラインセスも Apache 2.0 にて提供しており、自由に使って頂く事を想定しています。

- WebRTC SFU Sora iOS SDK

- https://github.com/shiguredo/sora-ios-sdk-quickstart

- https://github.com/shiguredo/sora-ios-sdk-samples

WebRTC ネイティブ iOS ライブラリ API ガイド

- WebRTC SFU Sora Android SDK

- https://github.com/shiguredo/sora-android-sdk-quickstart

- https://github.com/shiguredo/sora-android-sdk-samples

- shiguredo/sora-cpp-sdk: WebRTC SFU Sora C++ SDK

- https://github.com/shiguredo/sora-cpp-sdk-samples

コンソールから WebRTC を利用できる Momo に対応しています。

shiguredo/momo: WebRTC Native Client Momo

Sora 専用の負荷試験ツールを OSS として公開しています。

WebRTC Load Testing Tool Zakuro

このツールを利用することでキャパシティプランニングが可能になります。

Sora 専用の録画合成ツールを OSS として公開しています。

shiguredo/hisui: Recording Composition Tool Hisui

このツールを利用することで、別れて録画されたファイルを一つのファイルにすることが可能です。

クライアントや Sora の統計情報を Sora から受け取り TSDB (Time series database) に格納するツールを OSS として公開しています。

shiguredo/kohaku: WebRTC Stats Collector Kohaku

このツールを利用することで、問題があるクライアントの解析をより細かく解析が可能になります。

Sora から HTTP/2 経由で Opus を受け取り、音声解析サービスに送信しその結果を Sora に返すゲートウェイを公開しています。

shiguredo/suzu: Audio Streaming Gateway Suzu

このゲートウェイを利用する事で AWS や GCP の Speech To Text が簡単に利用できるようになります。

Sora の統計情報を OpenMetrics 形式で取得可能にするツールを公開しています。

shiguredo/sora_exporter: Prometheus exporter for WebRTC SFU Sora metrics

Sora が生成する録画ファイルを AWS S3 または S3 互換のオブジェクトストレージにアップロードするツールを公開しています。

shiguredo/sora-archive-uploader: Sora Archive Uploader

これは WebRTC SFU Sora を利用して録画した映像のサンプル画像です。このサンプルには音声は含まれておりません。

コーデックは VP9 を利用し、ビットレートは 5000 Kbps で解像度はフル HD 、フォーマットは WebM 形式で録画しております。

映像はこちら、 26 M バイト程度あります。

https://dl.dropbox.com/s/36g3o9tlgtppea6/8d096fb4-6fd2-40d6-9637-115062a82bc6.webm

Firefox または Chrome で録画した WebM ファイルを見ることができます。このサンプルには音声は含まれておりません。

SFU (+TURN) 機能を持った WebRTC サーバです

- 最新版の Chrome と Firefox と Safari と Edge が繋がる WebRTC サーバを製品として提供します

- サーバ経由での片方向での音声/映像配信/データを可能にします

- SFU 1 台で WebRTC 経由で 10000 の片方向配信を可能にします

- マルチストリーム を使用した双方向での音声/映像配信/データを可能にします

- 常に マルチストリーム 前提で動作させます

- マルチストリームでは最大 12 人の双方向配信を可能にします

- マルチストリームでの一人当たりの利用帯域を人数関係なく固定することを可能にします

- サイマルキャストを片方向/双方向で利用可能にします

- Opus に対応

- VP8, VP9, AV1, H.264, H.265 に対応

- 録画も可能

- スポットライト機能

- 1 チャネルに最大 100 人以上の双方向配信を可能にする機能です

- 音声が一定量を超えた配信者のみの音声や映像を配信する機能です

- 配信していない参加者のビットレートを自動で下げます

- 受信側がサイマルキャストのストリームを選択できるようにします

- サイマルキャストと帯域推定による動的な配信映像の変更を行います

- 帯域が厳しいと判断した場合は低画質の映像を受信します

- OBS から直接配信できるます

- 常に組み込みでの TURN 経由アクセスを行います

- username / credential な認証の仕組み自体は組み込みます

- TURN 機能もサーバ側に盛り込みます

- TURN-UDP 機能

- TURN-TCP 機能

- TURN-TLS 機能

- 録画/録音機能を組み込みます

- VP8, VP9, AV1, H.264, H.265 の録画に対応

- MP4 や WebM 形式での出力が可能

- 音声のみの Opus 録音機能

- サイマルキャスト機能利用時でも録画可能

- スポットライト機能利用時でも録画可能

- DataChannel を利用したシグナリングを採用します

- 最初だけ WebSocket を利用し WebRTC が確立したら DataChannel へ切り替わります

- 切断判定は WebSocket または DataChannel を利用できます

- DataChannel を了したリアルタイムメッセージ機能を提供します

- IPv6 対応

- NAT64/DNS64 対応

- クライアント SDK の提供

- クライアント SDK はすべて Apache 2.0 ライセンスにて OSS として公開します

- JavaScript (TypeScript)

- C++ SDK

- iOS (Swift)

- C++ SDK ベース

- Android (Kotlin)

- C++ SDK ベース

- Unity (C++)

- C++ SDK ベース

- Python SDK (C++)

- C++ SDK ベース

- Rust SDK

- サンプルアプリの提供

- Apache 2.0 ライセンスにて公開します

- TypeScript

- iOS (Swift)

- Android (Kotlin)

- Unity (C#)

- C++

- Python

- Rust

- 変換機能

- クライアント側で処理をお願いします

- P2P 経由への対応

- P2P 専用シグナリングサーバをオープンソースにて公開、維持していくプロジェクトがありますのでそちらをお使い下さい

- OpenAyame プロジェクト

- x86_64

- arm64

Linux のみに対応しており、Windows への対応は行いません

- Ubuntu 24.04 x86_64

- Ubuntu 24.04 arm64

- Ubuntu 22.04 x86_64

- Ubuntu 22.04 arm64

- Red Hat Enterprise Linux 10 x86_64

- Red Hat Enterprise Linux 9 x86_64

- Red Hat Enterprise Linux 8 x86_64

最新の安定版ブラウザのみに対応します

- Chrome

- Firefox

- Edge

- Safari

| Sora バージョン: | 2024.1 |

|---|---|

| コア数: | 最低でも 500 kbps 利用時で 100 ストリーム利用の場合は 2 コア以上必要 |

| メモリ: | 1G 以上 |

1:N とマルチストリームではストリームの数が接続数と一致しないため、ここではストリーム数で表現しています。

また実際に送られるパケット数も全く異なるため 1:N とマルチストリームでのストリーム数をそのまま計算するのは難しいです。

利用している CPU やビットレート、クライアントごとの回線状況などで CPU 利用率は大きく変わってくるため、必ず自社で負荷の検証をお願いします。

マシンスペックや配信ビットレート、ネットワーク環境に依存しますが最大 1:10000 の配信を超低遅延で実現可能です。

マシンスペック依存になりますが、 1:500 の映像のみ配信 x 8 の合計 4000 接続に成功しています。

連続した安定的な配信を可能にします。 18 ヶ月以上の無停止連続稼働を実現しています。

パケットロストした RTP パケットを再取得する Generic-NACK 機能に対応しており、画質を安定して配信することが可能です。

Safari TP を利用して 1:1 での配信と視聴を行いました。ちなみにサーバはは Linode のサーバにおいてあります

- 上の映像が Safari のフェイクカメラをそのまま流している映像です

- 下の映像が WebRTC SFU Sora を経由した映像です

遅延は 100 ミリ秒程度でした。これはかなり遅延が少ないと思います。

ライセンスは 1 年間毎での更新が必要です。3 ヶ月と 6 ヶ月のライセンスも用意しています。

WebRTC SFU Sora は時雨堂が1から開発したパッケージ製品です。自社のサーバにインストールしてご利用ください。

100 同時 接続利用可能なライセンスが 84 万円/年でご利用頂けます。

ライセンス費用の詳細につきましては、 https://sora.shiguredo.jp/price をご確認ください。

大量のライセンスを購入いただいた方向けの割引もありますので、お気軽に sora at shiguredo.jp までご質問ください。

| URL: | https://sora-cloud.shiguredo.jp/ |

|---|

利用時間や転送量ではなく、同時接続数と帯域で課金する Sora のクラウド版です。

Sora を構築、運用、監視する必要がなくなります。

Sora ともつながるブラウザなしで様々な環境で動作する WebRTC ネイティブクライアントをオープンソースにて公開しています。

ハードウェアエンコーダに対応することで Jetson Nano を使った 4K@30 での配信や Raspberry Pi Zero を利用して 720p での配信など実現が可能です。

P2P で 1:1 向けのシグナリングサーバをオープンソースにて公開しています。 Web SDK を用意しています。

仕様がとてもシンプルで、さらにオープンになっているため、気軽にクライアント側を開発可能です。

Ayame を利用した無料で利用できるサービスを公開しています。気軽に WebRTC を体験してみてください。

検証目的であれば無料で WebRTC SFU Sora を試せるサービスです。気軽に WebRTC SFU を体験してみてください。